ChatGPT og Googles Gemini har dukket opp som ledende krefter i kappløpet om overlegne store språkmodeller. Det er tydelig at disse plattformene har transformert AI-industrien. Likevel har måten de tilegner seg informasjon og håndterer datasett på vært en kontinuerlig etisk bekymring.

BeInCrypto snakket med fremvoksende AI-prosjekter i Web3, inkludert ChainGPT, Space ID, Sapien.io, Vanar Chain, O.XYZ, AR.IO og Kindred, for å diskutere de moderne bekymringene rundt immaterielle rettigheter, opphavsrett og eierskap. En viktig konklusjon var potensialet til desentralisert kunstig intelligens (deAI) som et verdig alternativ.

Fremveksten av LLMs og datainnsamlingsdilemmaet

Siden deres opprettelse har store språkmodeller (LLMs) raskt fått utbredt bruk. På mange måter var plattformer som OpenAIs ChatGPT og Googles Gemini offentlighetens første reelle kontakt med kunstig intelligens (AI) og deres ubegrensede brukspotensial.

Likevel har disse selskapene også blitt gransket for sin virksomhet. For å forbli konkurransedyktige trenger AI-modeller tilgang til et stort antall datasett. LLM-er kan bare generere menneskelignende svar og forstå komplekse forespørsler ved å behandle enorme mengder tekst.

For å få dette til å skje, kanaliserer ledende teknologigiganter som OpenAI, Google, Meta, Microsoft, Anthropic og Nvidia i stor grad all tilgjengelig data og informasjon på internett for å trene sine AI-modeller. Denne tilnærmingen har reist alvorlige spørsmål om hvem som eier innholdet disse plattformene inntar og senere gjengir i form av output.

Til tross for AIs forstyrrende potensial, har bekymringer over immaterielle rettigheter endt opp i svært omstridte rettssaker.

Bygger AI-selskaper imperier på stjålet innhold?

Rask AI-adopsjon har reist bekymringer angående dataeierskap, personvern og potensielle brudd på opphavsrett. Et sentralt stridspunkt er bruken av opphavsrettsbeskyttet materiale for å trene sentraliserte AI-modeller som store selskaper eksklusivt kontrollerer.

“AI-selskaper bygger imperier på ryggen av skapere uten å be om tillatelse eller dele byttet. Forfattere, kunstnere og musikere har brukt år på å perfeksjonere sitt håndverk, bare for å finne sitt arbeid inntatt av AI-modeller som genererer kopiversjoner på sekunder,” sa Jawad Ashraf, administrerende direktør i Vanar Chain, til BeInCrypto.

Dette problemet har virkelig forårsaket utbredt misnøye. Vanar Chain-direktøren la til at OpenAI og andre åpent har innrømmet å skrape opphavsrettsbeskyttet materiale, noe som har utløst søksmål og en bredere oppgjør over dataetikk.

“Kjernen i problemet er kompensasjon—AI-selskaper hevder at skraping av offentlig tilgjengelige data er rettferdig spill, mens skapere ser det som dagslysran,” uttalte Ashraf.

Definere grensene for AI-generert arbeid

The New York Times anla et søksmål mot OpenAI og Microsoft i desember 2023, med påstand om brudd på opphavsretten og uautorisert bruk av deres immaterielle eiendom.

The Times anklaget Microsoft og OpenAI for å ha skapt en forretningsmodell basert på “ulovlig kopiering og bruk av The Times unikt verdifulle verk.” Avisen hevdet også at disse modellene “utnytter og, i mange tilfeller, beholder store deler av den opphavsrettsbeskyttede uttrykksformen som finnes i disse verkene.”

Fire måneder senere saksøkte åtte flere nyhetsutgivere som opererer i seks forskjellige amerikanske stater Microsoft og OpenAI for brudd på opphavsretten.

The Chicago Tribune, The Denver Post, The Mercury News i California, New York Daily News, The Orange County Register i California, Orlando Sentinel, Pioneer Press of Minnesota og Sun Sentinel i Florida – alle hevdet at de to teknologiselskapene brukte artiklene deres uten autorisasjon i AI-produkter og feilaktig tilskrev dem unøyaktig informasjon.

“Domstoler blir nå tvunget til å svare på spørsmål som ikke eksisterte for noen år siden: Utgjør AI-generert innhold avledet verk? Kan opphavsrettsinnehavere kreve erstatning når dataene deres brukes uten samtykke?” sa Trevor Koverko, medgründer av Sapien.io, til BeInCrypto.

I tillegg til journalistorganisasjoner har utgivere, forfattere, musikere og andre innholdsskapere iverksatt rettslige skritt mot disse teknologiselskapene over opphavsrettsbeskyttet informasjon.

Juridiske kamper på tvers av bransjer

Bare forrige uke kunngjorde tre bransjegrupper at de vil saksøke Meta i en domstol i Paris, med påstand om at Meta “massivt brukte opphavsrettsbeskyttede verk uten autorisasjon” for å trene sine generative AI-drevne chatbot-assistenter, som brukes på tvers av Facebook, Instagram og WhatsApp.

I mellomtiden saksøkte visuelle kunstnere Sarah Andersen, Kelly McKernan og Karla Ortiz AI-kunstgeneratorer Stability AI, DeviantArt og Midjourney for å bruke deres arbeid til å trene sine AI-modeller.

“Det er ingen ende på bekymringene når det kommer til uregulert bruk av data og kreativt materiale av sentraliserte AI-selskaper. For øyeblikket kan enhver kunstner, forfatter eller musiker med offentlig tilgjengelig materiale få sitt arbeid gjennomsøkt av AI-algoritmer som lærer å skape nesten identisk innhold—og tjene på det mens kunstneren ikke får noe,” argumenterte Phil Mataras, grunnlegger av AR.IO.

OpenAI og Google hevder spesielt at hvis lovgivning begrenser deres tilgang til opphavsrettsbeskyttet materiale, vil USA tape AI-kappløpet mot Kina. Ifølge dem opererer selskaper i Kina med færre regulatoriske begrensninger, noe som gir deres rivaler en viktig fordel.

Disse gigantene driver aggressiv lobbyvirksomhet overfor den amerikanske regjeringen for å klassifisere AI-trening på opphavsrettsbeskyttede data som “fair use.” De hevder at AI-behandlingen av opphavsrettsbeskyttet innhold resulterer i nye utganger som er fundamentalt forskjellige fra kildematerialet.

Imidlertid, ettersom generative AI-verktøy i økende grad produserer tekst, bilder og stemmer, forfølger mange bransjer juridiske utfordringer mot disse selskapene.

“Innholdsskapere—enten de er forfattere, musikere eller programvareutviklere—sier ofte at deres [intellektuelle eiendom] blir brukt på måter som går utover fair use, spesielt når AI-systemer kopierer eller replikerer aspekter av deres originale verk,” sa Ahmad Shadid, grunnlegger og administrerende direktør i O.XYZ.

I mellomtiden, i Web3, lobbyer aktører for et alternativ til tradisjonelle selskapers tilnærming til LLM-utvikling.

DeAI dukker opp som Web3-alternativet

Desentralisert AI (deAI) er et fremvoksende felt i Web3 som utforsker bruk av blokkjede og distribuert hovedboksteknologi for å skape mer demokratiske og transparente AI-systemer.

“DeAI, som utnytter blokkjede og distribuert hovedboksteknologi, har som mål å adressere eierskap av data og opphavsrettsproblemer ved å skape mer transparente AI-systemer. Det distribuerer utviklingen og kontrollen av AI-modeller over et globalt nettverk, og etablerer rettferdigere modeller for AI-trening som respekterer innholdsskapernes rettigheter. DeAI har også som mål å gi mekanismer for rettferdig kompensasjon til skapere hvis arbeid brukes i AI-trening, og potensielt løse mange av problemene knyttet til sentraliserte AI-modeller,” forklarte Max Giammario, administrerende direktør og grunnlegger av Kindred.

Med AIs voksende globale fremtreden, lover dens fusjon med blokkjede å transformere begge sektorer, og skape nye veier for kryptoinnovasjon og investering.

Som svar har aktører i bransjen allerede begynt å utvikle vellykkede prosjekter som kombinerer AI og Web3-teknologier.

I motsetning til selskaper som produserer sentraliserte AI-modeller, har deAI som mål å være fullstendig åpen kildekode.

OpenAI har tidligere hevdet at det overholder den amerikanske fair use-doktrinen til tross for bruk av opphavsrettsbeskyttet materiale for å trene sine AI-modeller. Videre er ChatGPT, deres mest populære applikasjon, helt gratis å bruke.

Harrison Seletsky, direktør for forretningsutvikling i Space ID, fremhevet en motsigelse i OpenAIs argument.

“Det klare etiske problemet er at materialer blir brukt uten eksplisitt tillatelse fra deres skapere. Hvis de er opphavsrettsbeskyttet, må tillatelse gis, og vanligvis betales et gebyr. Men utover det, selv om LLM-er som ChatGPT bruker åpen kildekode-data, er ikke OpenAIs modeller åpen kildekode. De bruker offentlig tilgjengelig materiale uten å fullt ut ‘gi tilbake’ til kildene de henter fra.

Det er et overordnet spørsmål her om AI bør være åpen kildekode. OpenAIs ChatGPT er det ikke, mens modeller som Kinas DeepSeek er det, samt desentralisert AI. Fra et etisk og intellektuelt eiendomsrettsperspektiv er sistnevnte absolutt et bedre valg,” sa Seletsky.

Disse teknologigigantenes sentraliserte kontroll reiser også andre bekymringer angående implementeringen og tilsynet med AI-modeller.

Sentralisert vs. desentralisert: Etiske og operasjonelle forskjeller

I kontrast til den fellesskapsdrevne naturen til deAI, er sentraliserte AI-modeller bygget av et lite antall mennesker, noe som kan føre til potensielle skjevheter.

“Sentralisert AI opererer vanligvis under en enkelt bedrifts paraply, hvor beslutninger er drevet av en top-down profittmotiv. Det er i hovedsak en svart boks eid og administrert av én enhet. I kontrast, stoler deAI på en fellesskapsdrevet tilnærming. AI-en er designet for å analysere tilbakemeldinger fra fellesskapet og optimalisere for kollektive interesser i stedet for bare bedriftsinteresser,” forklarte Ahmad Shadid, grunnlegger og administrerende direktør i O.XYZ.

I mellomtiden gir blokkjede-teknologi en klar vei for inntektsgenerering.

“Skapere kan tokenisere sine kreative aktiva—som artikler, musikk eller til og med ideer—og sette sine egne priser. Dette skaper et rettferdigere miljø for både skapere og brukere av intellektuell eiendom, og danner i hovedsak et fritt marked for IP. Det gjør også eierskap lett å bevise, ettersom alt på blokkjeden er transparent og uforanderlig, noe som gjør det mye vanskeligere for andre å utnytte noens arbeid uten å justere insentivene riktig,” fortalte Seletsky til BeInCrypto.

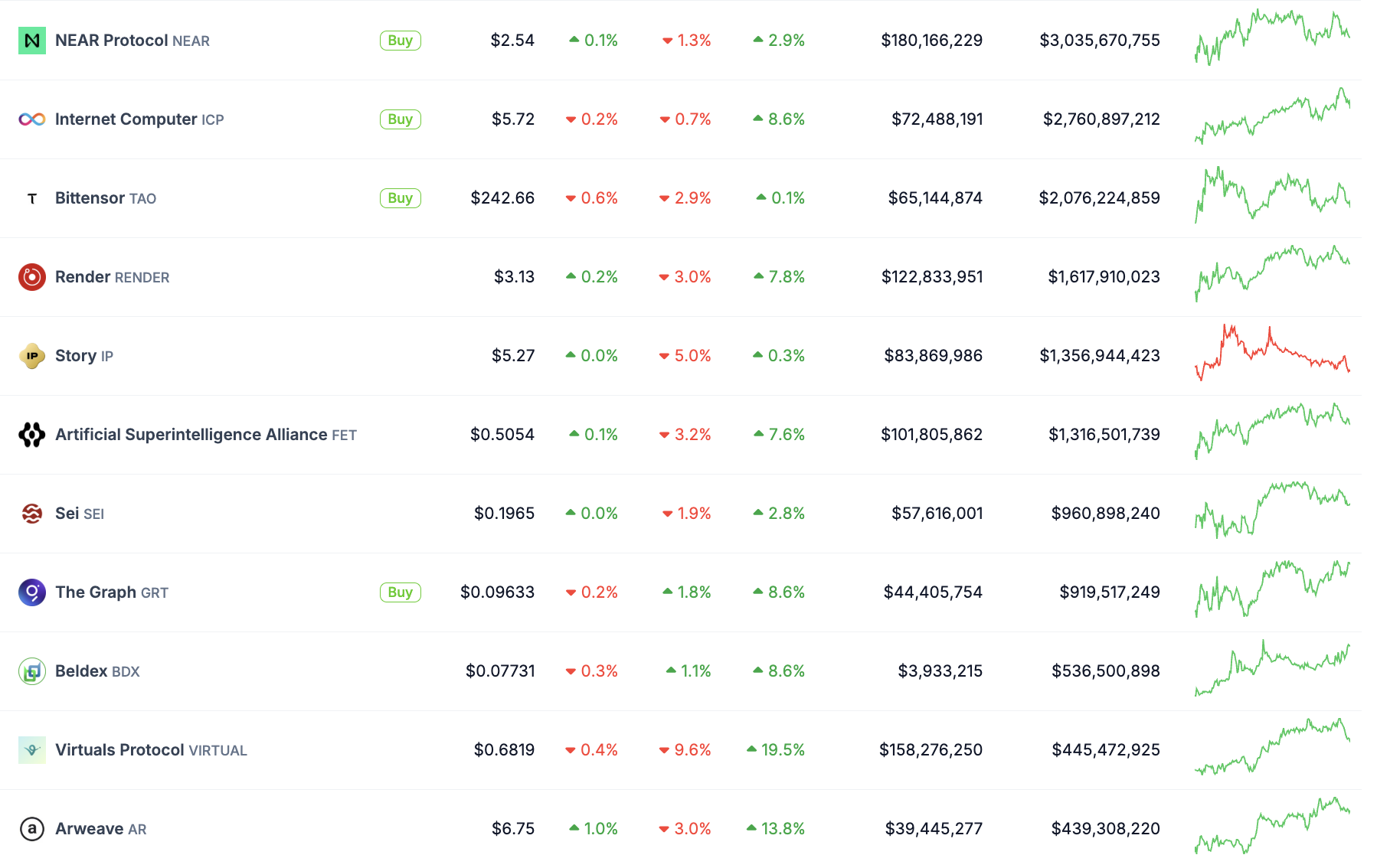

Ulike Web3-utviklere har allerede utviklet prosjekter som desentraliserer innhold brukt for generativ AI. Plattformene som Story, Inflectiv og Arweave utnytter ulike aspekter av blokkjede-teknologi for å sikre at datasett brukt for AI-modeller er etisk kuratert.

Ilan Rakhmanov, grunnlegger av ChainGPT, ser på deAI som en viktig motkraft til sentralisert AI. Han hevder at det å adressere de uetiske praksisene til eksisterende AI-monopoler vil være essensielt for å dyrke en sunnere industri i fremtiden.

“Dette setter en farlig presedens der AI-selskaper fritt kan bruke opphavsrettsbeskyttet innhold uten riktig attribusjon eller betaling. Juridisk sett inviterer dette til reguleringsgranskning; etisk sett fratar det skapere kontroll. ChainGPT tror på on-chain attribusjon og inntektsgenerering, som sikrer en rettferdig verdibytte mellom AI-brukere, bidragsytere og modelltrenere,” sa Rakhmanov.

Men for at DeAI skal ta sentrum, må det først overvinne flere hindringer.

Hvilke hindringer står deAI overfor?

Selv om deAI har spirende potensial, er det også i sine tidlige stadier. I den forbindelse har selskaper som OpenAI og Google overtaket når det gjelder økonomisk styrke og infrastruktur. De har midlene til å håndtere de enorme ressursene som trengs for å skaffe så store datamengder.

“Sentraliserte AI-selskaper har tilgang til massiv datakraft, mens deAI trenger effektive, distribuerte nettverk for å skalere. Så er det data—sentraliserte modeller trives på oppsamlede datasett, mens deAI må bygge pålitelige rørledninger for å skaffe, verifisere og kompensere bidragsytere rettferdig,” fortalte Koverko til BeInCrypto.

Til det punktet la Ahmad Shadid til:

“Å bygge og drive AI-systemer på distribuerte hovedbøker kan være komplisert, spesielt hvis du prøver å håndtere store datamengder i skala. Det krever også nøye tilsyn for å holde AI-læringsprosessene i tråd med fellesskapets etikk og mål.”

Disse teknologiske kraftsentrene kan også bruke sine ressurser og forbindelser til å lobbye hardt mot konkurrenter som deAI.

“De kan gjøre det ved å gå inn for reguleringer som favoriserer sentraliserte modeller, utnytte deres markedsdominans for å begrense konkurranse, eller kontrollere nøkkelressurser som er nødvendige for AI-utvikling,” sa Giammario.

For Ashraf bør sannsynligheten for at dette skjer tas for gitt.

“Når hele forretningsmodellen din er bygget på å hamstre data og tjene penger på det i hemmelighet, er det siste du ønsker et åpent, transparent alternativ. Forvent at AI-giganter vil lobbye mot DeAI, presse for restriktive reguleringer og bruke sine enorme ressurser til å diskreditere desentraliserte alternativer. Men internett selv startet som et desentralisert system før selskaper tok over, og folk våkner opp til ulempene ved sentralisert kontroll. Kampen for åpen AI har bare så vidt begynt,” forutså Jawad Ashraf, administrerende direktør i Vanar Chain.

For å fremme sitt oppdrag, må deAI imidlertid øke sin offentlige bevissthet, nå både Web3-brukere og de utenfor rommet.

Å bygge bro over kunnskapsgapet

Da Seletsky fra Space ID ble spurt om de viktigste hindringene deAI står overfor, sa han at folk må være klar over problemet med brudd på opphavsrett i AI-modeller for å løse det.

“Den største hindringen er mangel på utdanning. De fleste brukere vet ikke hvor dataene kommer fra, hvordan de blir analysert og hvem som kontrollerer dem. Mange innser ikke engang at AI har skjevheter, akkurat som mennesker. Det er behov for å utdanne den gjennomsnittlige personen om dette før de kan forstå fordelene med desentraliserte AI-modeller,” sa han.

Når publikum forstår opphavsrettsproblemene innen sentraliserte AI-modeller, må deAI-forkjempere aktivt demonstrere deAIs fordeler som et sterkt alternativ. Til tross for økt bevissthet, står deAI fortsatt overfor adopsjonsutfordringer.

“Adopsjon er en annen utfordring. Bedrifter er vant til nøkkelferdige AI-løsninger, og deAI må matche det nivået av tilgjengelighet samtidig som det beviser sine fordeler innen sikkerhet, åpenhet og innovasjon,” sa Koverko.

Veien videre: Regulatorisk klarhet og offentlig tillit

Med utfordringene innen utdanning og tilgjengelighet adressert, avhenger veien til bredere deAI-adopsjon av å etablere regulatorisk klarhet og bygge offentlig tillit. Trevor Koverko, medgründer av Sapien.io, la også til at deAI trenger medfølgende regulatorisk klarhet for å nå disse målene.

“Uten klare rammeverk risikerer deAI-prosjekter å bli satt på sidelinjen av juridisk usikkerhet mens sentraliserte aktører presser på for politikk som gagner deres dominans. Å overvinne disse utfordringene betyr å finjustere vår teknologi, bevise reell verdi og bygge en bevegelse som presser for åpen, demokratisert AI,” hevdet han.

Shadid var enig i behovet for større institusjonell støtte, og la til at det bør kombineres med å bygge større offentlig tillit.

“Åpenhet kan være urovekkende hvis du har brukt tiår på å perfeksjonere proprietære metoder, så DeAI må bevise sin overlegenhet når det gjelder tillit og innovasjon. En annen hindring er å bygge nok brukertillit og regulatorisk klarhet slik at folk—og til og med regjeringer—føler seg komfortable med hvordan data håndteres. Den beste måten å få fotfeste på er å demonstrere virkelige brukstilfeller der desentralisert AI klart overgår sine sentraliserte motparter eller i det minste beviser at den kan matche dem i hastighet, kostnad og kvalitet, samtidig som den er mye mer åpen og rettferdig,” forklarte Ahmad Shadid.

Til syvende og sist krever opphavsrettsbekymringene rundt AI-modeller et paradigmeskifte, med fokus på å respektere intellektuell eiendom og fremme et mer demokratisk AI-økosystem– uavhengig av deAIs endelige innvirkning.