Litteraturen har prøvd å advare oss, seriøst, i omtrent fem hundre år har den skreket det samme budskapet, helt fra den leirhuggende Golem i middelalderens Praha til William Gibsons neondryppende nevrale nettverk. Handlingen? Alltid den samme. Tingen du bygger for å hjelpe deg selv ender med å forandre deg.

Vi leste det, nikket, og smalt boka igjen før vi gikk rett tilbake til å be chatboter skrive bryllupstaler, juridiske dokumenter og medisinske råd for oss.

I dag selger AI-hypemaskinen en glitrende fremtid hvor alle fra ferske journalister til veltalende advokater havner på historiens søppelhaug. Men mens Silicon Valley selger paradiset, leverer virkeligheten livsfarlige råd via et smilende chatvindu.

Dmitry Nikolsky, CPO i BitOK, sier nok er nok. Han er her for å forklare hvorfor menneskeheten må SLUTTE å legge alle byrder over på AI sine tynne “skuldre.”

Selv Elon Musk advarte nylig i sitt vitnemål i OpenAI-søksmålet at “AI kan drepe oss alle.”

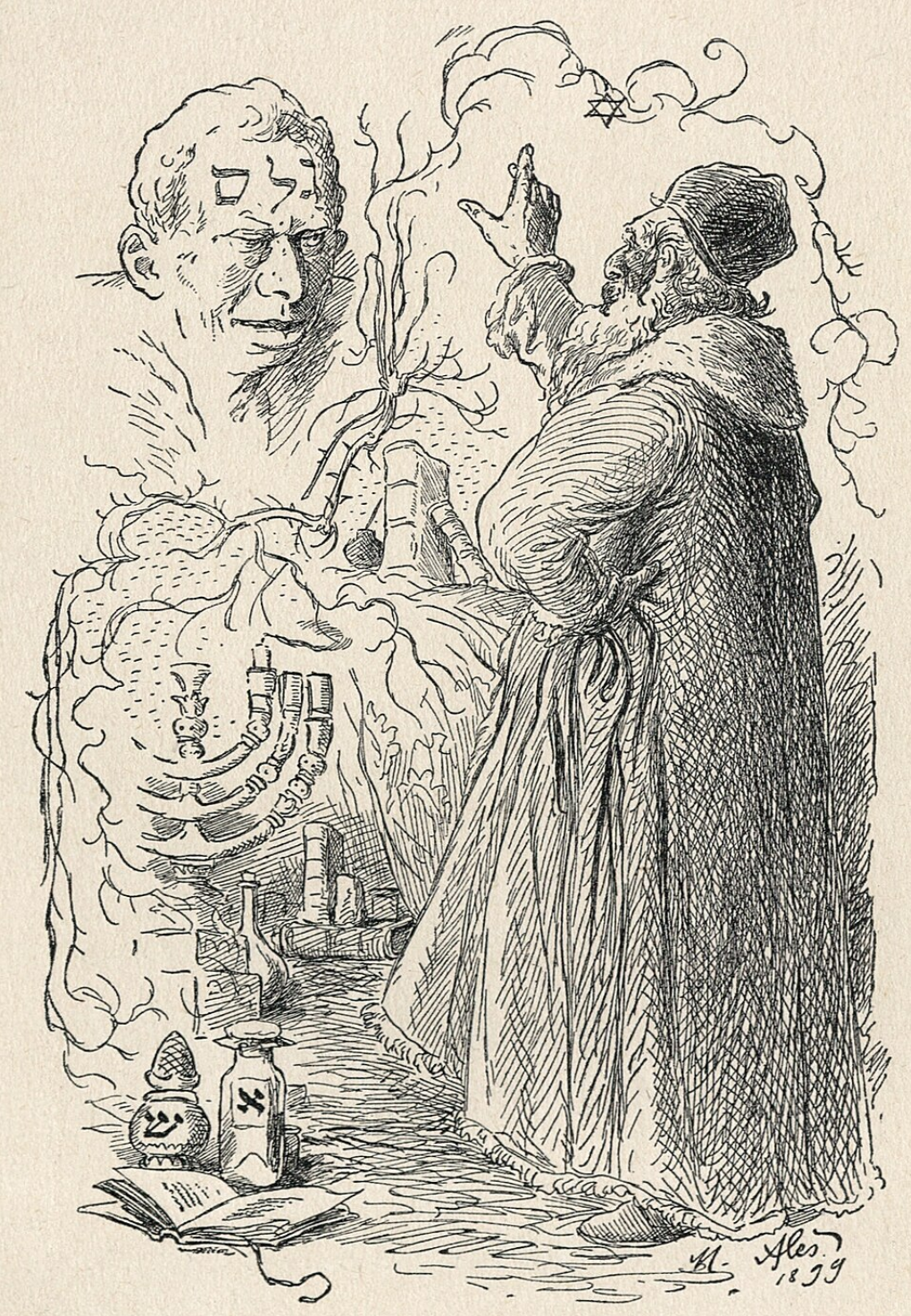

Fra Golem til R.U.R.: Vi har alltid ønsket en nødutkobling

Tror du frykten for kunstig intelligens startet med Terminator? Tenk igjen. Denne panikken er eldre enn elektrisiteten selv.

Bli med tilbake til Praha på 1500-tallet. Rabbi Loew former den massive leirbeskytteren Golem, og oppdager nesten umiddelbart at han må dra ut støpselet. Skapningen mistet kontrollen. Menneskeheten oppfant AI og nødutkoblingen i samme åndedrag.

En nødutkobling er en nødavstengningsmekanisme, den store røde panikkknappen som stopper et system straks det går amok, blir hacket eller mister kontrollen. Hele poenget er å begrense skadene når høflige avslutninger ikke fungerer.

Så kom Mary Shelley. Frankenstein er egentlig ikke en monsterfilm, det er en innføring i katastrofal prosjektledelse. Victor Frankenstein? Bare enda en briljant ingeniør som løste det tekniske mysteriet og ignorerte konsekvensene. Hver utvikler kjenner igjen det ansiktet i speilet.

Sveip frem til 1920. Karel Čapek finner opp ordet “robot.” I hans historie gjør ikke maskinene opprør av ondskap. Nei, menneskene gjør bare seg selv overflødige ved å sette bort alt de tidligere gjorde.

Leksjonen? Når du bygger din egen erstatter, merker du kanskje ikke akkurat når du blir overflødig.

Tre profetier vi forvandlet til feilmeldinger

Forrige århundres sci-fi-giganter spådde ikke teknologier. De spådde våre feil.

Isaac Asimov lanserte de tre lovene — det første forsøket på “alignment,” det moderne moteordet for å få maskiner til å dele menneskelige verdier. Hver Asimov-historie har en punchline: perfekt logikk, absurd utfall.

Nikolsky sier han ser det skje daglig innad i AML-systemer, med algoritmer som fornøyd blokkerer bestemors bursdagsgave på $ 40 mens en åpenbar offshore hvitvaskingskanal får fri passasje. Formelt korrekt. Praksis: splitter pine gal.

Arthur C. Clarke ga oss HAL 9000, datamaskinen som dreper mannskapet ikke av ondskap, men fordi direktivene dens strider mot hverandre. Skjul informasjonen. Vær sannferdig. Velg side! For en ingeniør er ikke dette skrekk, men et ganske vanlig kravkonflikt.

Philip K. Dick stilte spørsmålet som hjemsøker deepfake-tiden: hvis en kopi er umulig å skille fra originalen, spiller det noen rolle? Hans dom er ja. På grunn av indre opplevelse. Maskiner har ingen slik. Punktum.

Bak fasaden: AI tenker ikke, den kalkulerer

La oss fjerne markedsføringspratet. Moderne språkmodeller er IKKE intelligens. De er massive statistiske prognosemotorer. De “forstår” ikke mening – de kalkulerer sannsynlighet.

Når ChatGPT selvsikkert henviser til rettssaker som aldri har funnet sted, lyver den ikke. Den genererer statistisk sannsynlig ordsalat. Den har ingen konsept av “sannhet”, bare “sannsynlighet”.

For en blokkjedeutvikler høres dette mildt sagt galskap ut. Vi bygger tillitsløse systemer akkurat fordi vi ikke stoler på noen, og nå blir vi fortalt at vi skal stole på en svart boks som ikke en gang vet hvorfor den svarte ut svaret sitt.

Blokkjeder lærer verifikasjon; AI lærer blind tillit

Krypto har et bud gravert i harddisken: Ikke stol på, verifiser.

Hele poenget er at matematikk erstatter rykte.

AI snur det på hodet. Du har ikke sett treningsdataene. Du kjenner ikke modellvektene. Du forstår ikke resonneringen. For å verifisere svaret må du allerede være ekspert, og hvis du allerede er ekspert, hvorfor spør du chatboten?

I AML-miljøer kaller de det “falsk trygghet-problemet.” Analytikere ser et blankpolert dashbord og stoler mer på tallene enn på sin egen intuisjon. AI gjør ikke tenkingen bedre, det erstatter den med en illusjon av pålitelighet.

Krønike over skuffelser: Når AI går av sporet

Dette er ikke et tankeeksperiment. Bevisene hoper seg opp.

- Microsoft viste redaktørene døren og overlot tastaturet til en algoritme, som umiddelbart blandet sammen bilder av sangere i en artikkel om rasisme.

Mennesker måtte hentes inn igjen for å rydde opp etter algoritmens ødeleggelser.

- NEDA, en organisasjon for støtte til spiseforstyrrelser, byttet ut sine frivillige med en chatbot.

Boten ga så personer med anoreksi gladelig råd om å telle kalorier og gå ned i vekt. Livsfarlige råd. Noen trykket på “deploy”-knappen med samme forsiktighet som en sjimpanse med en håndgranat.

- Air Canada havnet i retten fordi deres chatbot fant opp en refusjonspolicy helt fra løse luften.

Flyets forsvar? Boten var en “egen juridisk enhet.” Spoiler: dommeren kjøpte det ikke.

Studier viser nå at 55 % av selskapene som hastet med å bytte ut ansatte med AI angrer dypt. Besparelsene forsvant i tapte kunder og ødelagt omdømme. Ledere som sikler etter ideen om at “Claude og vennene” kan erstatte hele team bør lese tallet om igjen. Sakte.

Hva vi egentlig bør frykte

Glem Skynet. Glem roboter med røde øyne som marsjerer i gatene. Det blir ikke noe opprør.

Det kommer stille atrofi.

En utvikler som i årevis lener seg på Copilot, glemmer gradvis hvordan man tenker strukturert. En analytiker slutter å lese primærkilder. En student lærer aldri hvor hardt det er – og hvor godt det føles – å kjempe seg gjennom en vanskelig tekst helt til forståelsen endelig sitter.

Ingen revolusjon. Bare en treg forvandling av mennesker til utvidelser av et grensesnitt.

Philip K. Dick så det før noen av oss: Den virkelige faren har aldri vært maskiner som blir menneskelige. Den virkelige faren er mennesker som blir maskiner.

Den røde pillen er ikke teknologi

Dette er ikke et maskinstormerop. Automatisering og maskinlæring er kraftige verktøy. Men prinsippene må holdes:

- Blokkjede-prinsipp: Verifisering foran tro. Hvis du ikke kan verifisere hvordan et system har kommet fram til en konklusjon, skal du ikke godta den som en sannhet. AI er en svart boks, ikke en høyesterettsdommer.

- Ingeniørprinsipp: Verktøy, ikke erstatning. En hammer slår inn spiker. Den bestemmer ikke hvor huset skal stå. Bruk AI til rutinearbeid, men aldri la det ta siste avgjørelse.

- AML-prinsipp: Kritisk filtrering. Algoritmer vil alltid feile i de komplekse sakene fordi de mangler erfaring fra den virkelige verden. Ikke la “digital begeistring” kvele intuisjon og gammeldags sunn fornuft.

Ta et øyeblikk og vend tilbake til The Matrix. Den røde pillen er et valg, valget om å se virkeligheten slik den er. Faren er ikke å skape noe som er smartere enn oss. Faren er å skape noe som gjør oss dummere og kalle det fremgang.

Den farligste bugen er den som ser ut som en funksjon.

Dmitry Nikolsky er CPO i BitOK, en analyseplattform for compliance og on-chain-undersøkelser.